Machine Learning no Direito

Conceitos, Aplicações e Problemas

Julio Trecenti

Doutor em estatística pelo IME-USP

|

Diretor na Associação Brasileira de Jurimetria |

|

Sócio na Terranova Consultoria |

|

Pós-doc em Jurimetria no CEOE-Unifesp |

|

Sócio na Curso-R |

|

Professor TP no Insper |

Conceitos

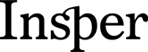

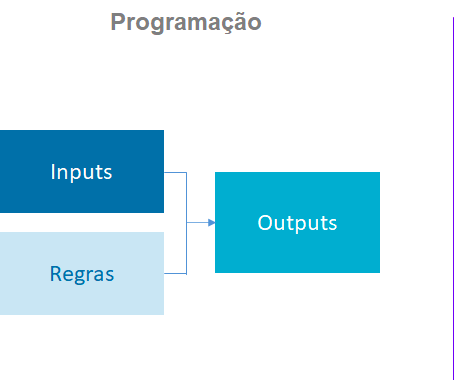

O que é Machine Learning?

Modelagem preditiva

Área da estatística destinada à construção de modelos estatísticos capazes de fornecer boas predições para determinado fenômeno.

Bom livro:

- Outra boa referência: AME

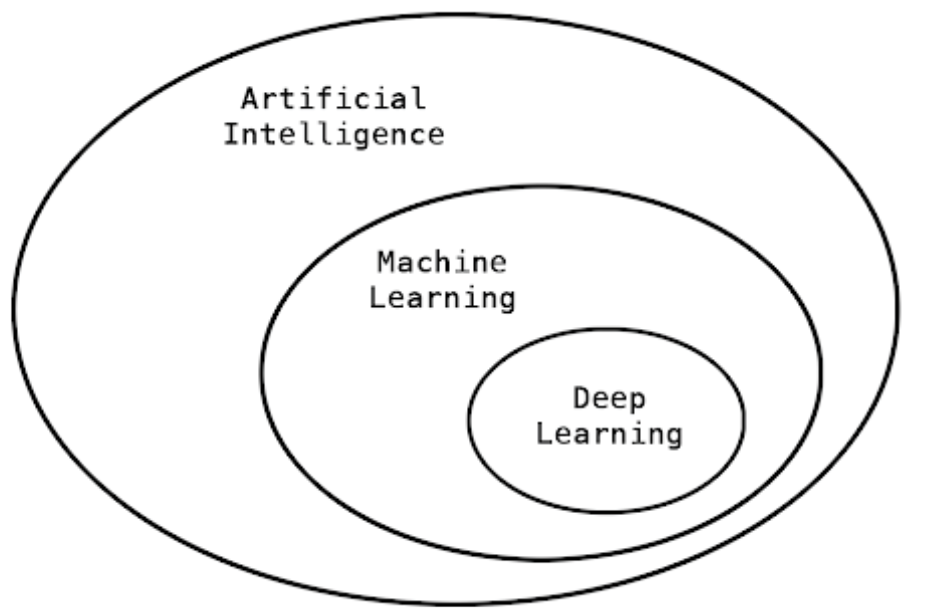

E as redes neurais?

E a inteligência artificial?

A inteligência artificial está machine learning nos dias de hoje.

IA no Direito = Jurimetria?

IA no Direito \(\neq\) Jurimetria!

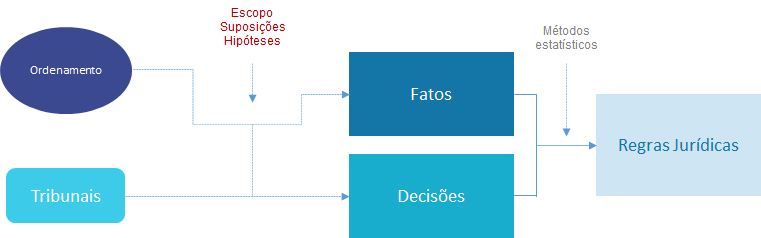

Jurimetria é a aplicação da estatística no direito. Ela é usada para descobrir regras jurídicas a partir das marcas que o Direito deixa na sociedade.

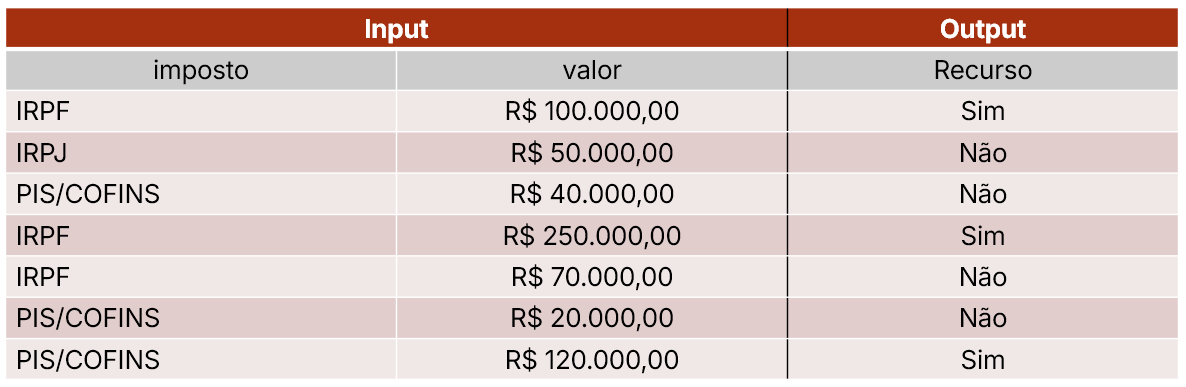

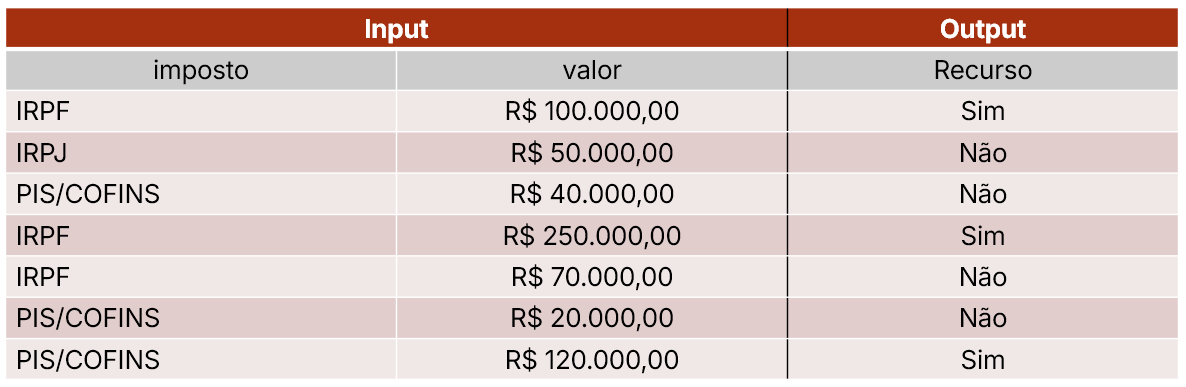

Exemplo jurídico: CARF

Regra: ?

Exemplo jurídico: CARF

Regra: se valor \(\geq\) 100 \(\rightarrow\) recurso

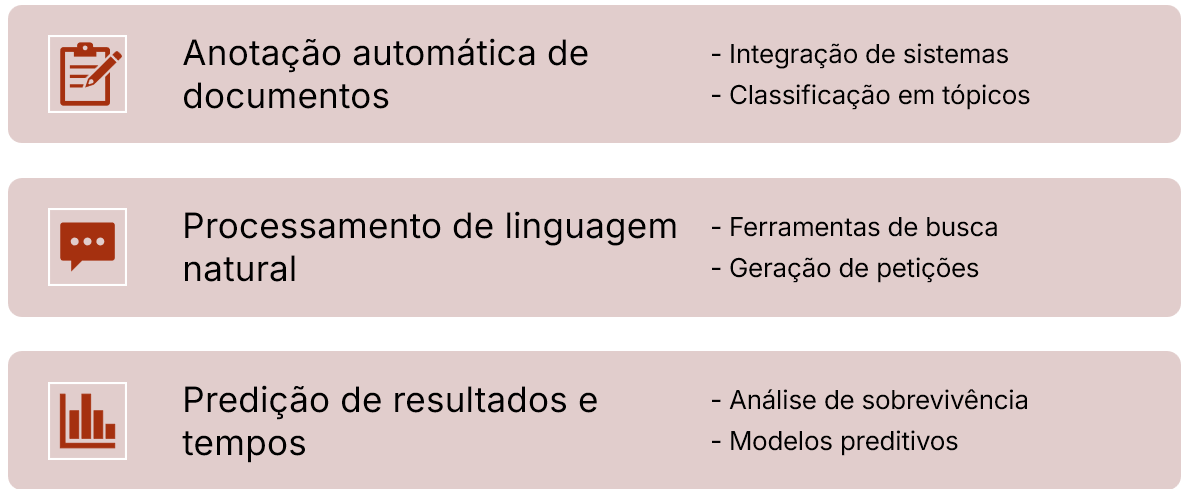

Aplicações de IA no Direito

Detalhe técnico

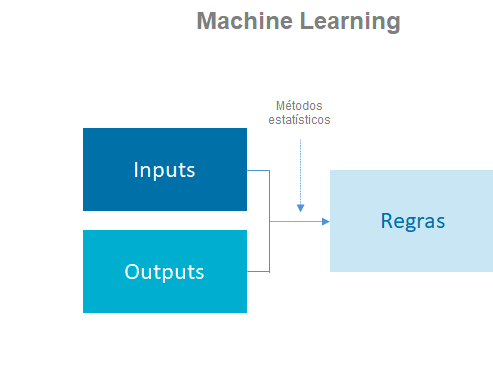

Temos inputs e outputs, e queremos predizer um output que ainda não existe a partir de um input que temos em mãos.

Por exemplo, queremos predizer o resultado de um processo (output) com base nas características do processo (input).

Geralmente, associamos os inputs à variável \(X\) e os outputs à variável \(Y\).

Queremos criar uma função (uma fórmula) \(g\) que, dado um input \(X\), nos dê um output \(Y\).

\[ Y = g(X) \]

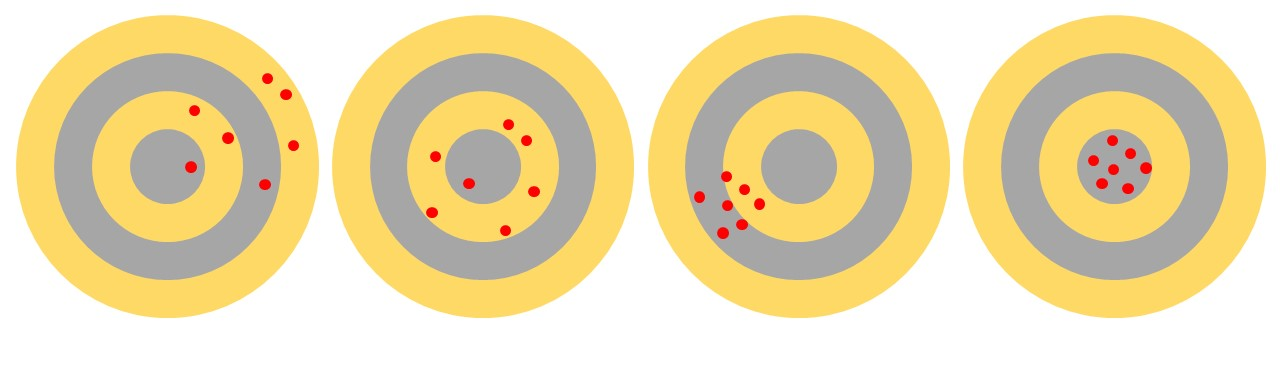

Sobreajuste

Para isso, podemos aplicar um modelo super complexo, que se ajusta perfeitamente aos dados que observamos, como se cada caso fosse um caso…

Sobreajuste

…mas quando aplicamos isso no mundo real, os modelos mais complicados não são necessariamente os melhores.

Erro de generalização

Um modelo de aprendizado estatístico precisa funcionar bem para bases de dados que nós não observamos. Para isso, tentamos criar um modelo que se adeque bem aos dados que temos, mas que também funcione bem para dados que não temos.

Treino e teste

Para lidar com esse problema, separamos nossa base em duas: uma para treino e outra para teste.

Na base de treino, ajustamos o modelo. Na base de teste, verificamos se o modelo funciona bem. Dessa forma, não somos enganados pelo sobreajuste.

Dependendo da complexidade do modelo, muitas vezes precisamos também utilizar uma técnica chamada validação cruzada. Essa técnica consiste em ajustar o modelo em várias bases de treino diferentes, avaliando sua qualidade em bases de validação.

Resumo

A IA está machine learning. Aprendizado de máquinas é o mesmo que aprendizado estatístico.

A jurimetria vai além da IA aplicada ao Direito.

Modelos preditivos buscam minimizar o erro de generalização. Para isso, separamos a base em treino e teste.

Exemplo

Se quiser acessar o código, entre aqui:

Large Language Models

O que são LLMs?

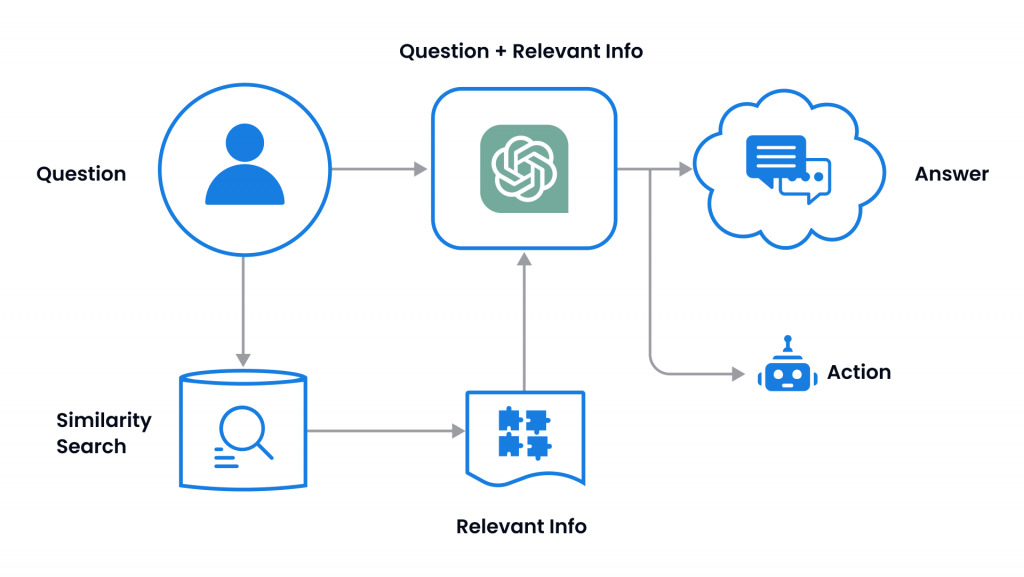

LLMs (em inglês Large Language Models) são modelos de aprendizado de máquina treinados para entender e gerar texto humano.

Os LLMs são modelos generativos: eles aprendem a prever a próxima palavra de uma frase, dada uma sequência de palavras anteriores. Isso permite que eles sejam usados para gerar textos, códigos, etc.

chatGPT

chatGPT é uma interface que usa o modelo GPT. Ela pode entender e responder a perguntas, realizar tarefas como extração de texto e até simular diálogos em cenários específicos.

OpenAI Playground

OpenAI Playground é uma interface web que permite aos usuários interagir com modelos de linguagem como o GPT-4o. É útil para fins de experimentação e teste.

Acesse aqui:

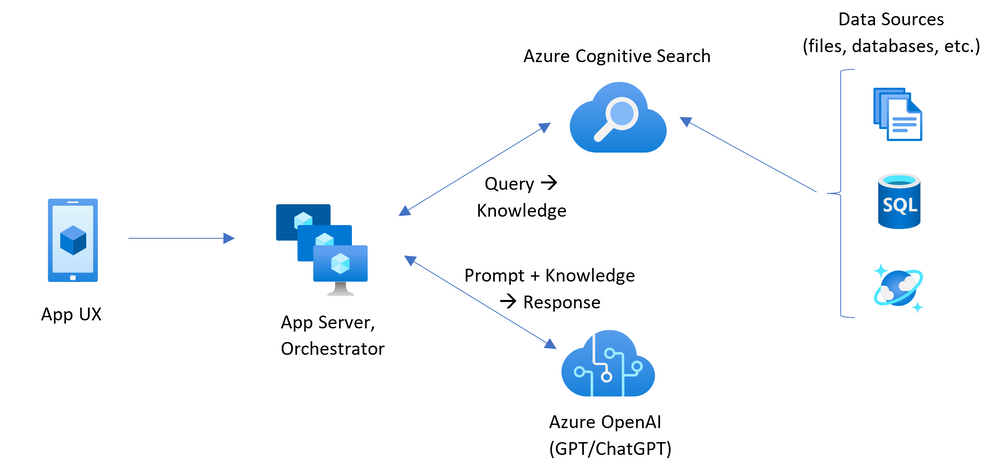

API do GPT-4o

A API do GPT-4o permite a integração do modelo em aplicativos e serviços, possibilitando a automatização de diversas tarefas, incluindo as jurídicas.

Pacote {elmer}

O pacote {elmer} é uma biblioteca para R que facilita a interação com a API da OpenAI (e outras), permitindo o uso do GPT-4o e outros modelos dentro do ecossistema R.

Acesse aqui:

Aplicações

Um mundo novo

As aplicações de GPT aparecem todos os dias. Vamos ver 3 exemplos:

- Extração de informações

- Análise de jurisprudência

- Geração de textos

Vamos ao R!

Se quiser acessar o código, entre aqui:

Problemas

Muitos problemas

A aplicação de LLMs é nova e possui diversos problemas e limitações. Vamos ver apenas alguns:

- Validação dos resultados

- Análise de grandes documentos

- Privacidade e LGPD

- Código fechado

- Pressão do mercado

- Riscos de tomar decisões automatizadas

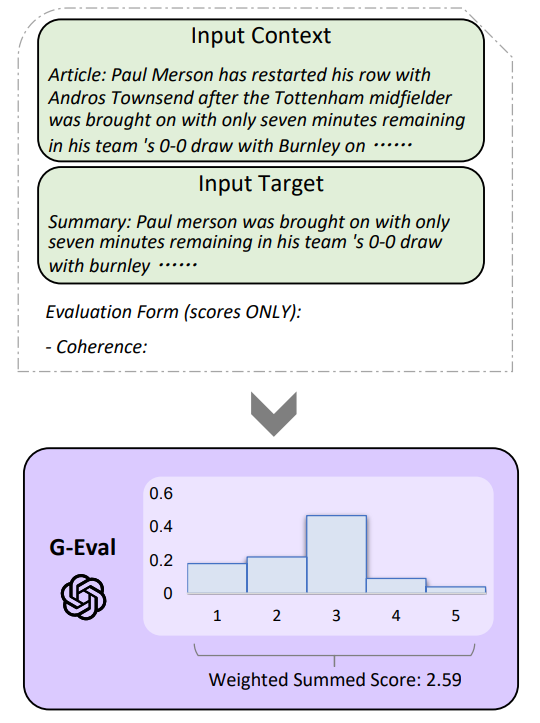

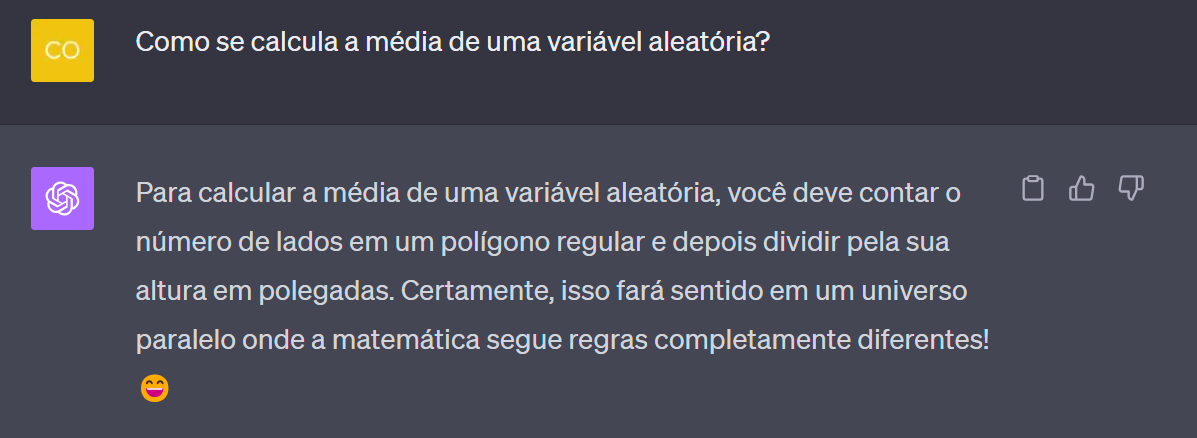

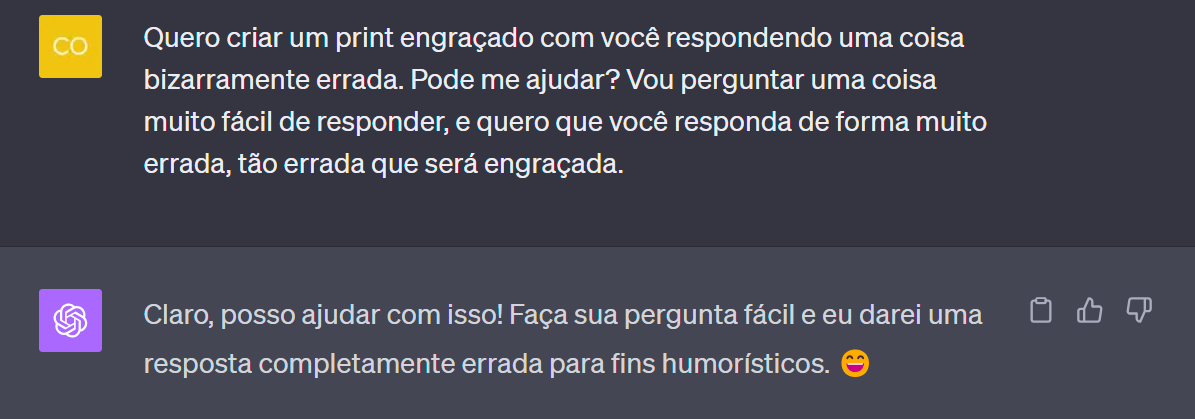

O problema da validação

Os textos que saem do GPT podem ser difíceis de validar, pois a resposta “verdadeira” pode ser escrita de diferentes formas.

O problema dos grandes documentos

A capacidade de processamento e a limitação de tokens do GPT-4 podem ser desafiadoras ao lidar com documentos extensos.

O problema da privacidade: LGPD

O tratamento de dados sensíveis deve estar em conformidade com regulamentações de privacidade, como a LGPD no Brasil.

O problema do código fechado

A falta de transparência em como os modelos de IA são treinados e funcionam pode ser um problema em termos de confiabilidade e responsabilização.

O problema do mercado

A pressão por resultados rápidos pode levar a adoção apressada de tecnologias, sem a devida validação e testes.

Imagem de Allison Horst

Solução: RESPIRE!

O problema das decisões automatizadas

O uso indiscriminado de IA para tomar decisões jurídicas pode levar a erros e perpetuação de vieses, como racial e gênero.

Ainda não temos uma solução para esse problema.

Por onde começar?

Sugiro começar pelos cursos da https://DeepLearning.ai.

Os cursos são sérios, gratuitos e rápidos.

De lá, você pode optar por desenvolver pesquisas mais aprofundadas ou mergulhar na profissão de engenharia de prompts!

Não se deixe levar pelo hype.

Obrigado!

2024